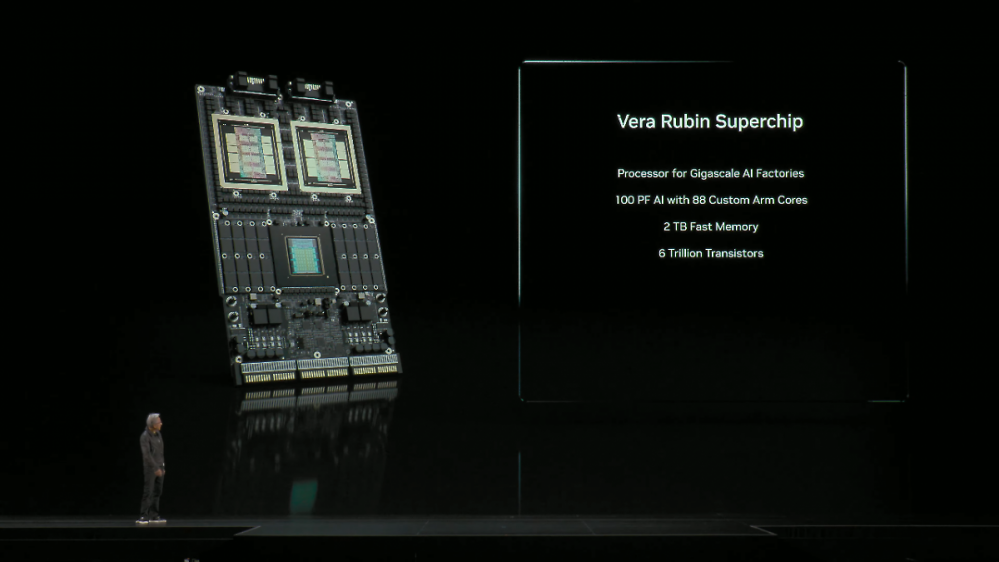

Superchip: Nvidia zeigt Vera Rubin zum ersten Mal öffentlich

Im Rahmen der Nvidia GTC 2025 hat Nvidia-CEO Jensen Huang den neuen Vera Rubin Superchip und die darauf basierenden Compute- und KI-Lösungen erstmals öffentlich gezeigt. Nvidias Next-Gen beeindruckt in vielerlei Hinsicht enorm.

Im Rahmen der Nvidia GTC ("GPU Technology Conference") 2025 in Washington, D.C., welche das Unternehmen aus Santa Clara mittlerweile als KI-Konferenz bezeichnet, hat Nvidia-CEO und Gründer Jensen Huang den neuen Vera Rubin Superchip und darauf basierende Compute- und KI-Lösungen erstmals öffentlich gezeigt. In technologischer Hinsicht beeindruckt Nvidias Next-Gen wieder enorm.

Der Nvidia Vera Rubin Superchip, welcher sich aus insgesamt zwei Rubin-GPUs mit 288 GiByte HBM4-Speicher und einer Vera-CPU mit 88 Custom-ARM-Prozessorkernen sowie 176 Threads zusammensetzt und von 2 Terabyte LPDDR5X-Systemspeicher flankiert wird, verbindet seine Komponenten über ein NVLink-C2C-Interconnect, welches eine Bandbreite von bis zu 1,8 Terabyte pro Sekunde bereitstellt.

Während der Vera Rubin Superchip eine FP4-Leistung von 50 PetaFLOPS bereitstellt, gehen die Lösungen auf Basis von Nvidias "Next-Gen-Superchip" noch einmal deutlich weiter. Das "Vera Rubin Compute Tray" mit vier Superchips erreicht 200 PetaFLOPS, während das "Vera Rubin CPX Compute Tray" mit acht zusätzlichen Rubin-GPUs insgesamt bis zu 440 PetaFLOPS Inference-Leistung bereitstellen kann.

Doch damit noch nicht genug: In der zweiten Jahreshälfte 2026 möchte Nvidia mit der Vera Rubin NVL144-Plattform eine Lösung anbieten, welche bis zu 3,6 ExaFLOPS ("FP4") für Inference und 1,2 ExaFLOPS ("PF8") für KI-Training bereitstellt.

Wie Nvidia-CEO Jensen Huang demonstrierte, stehen mit Rubin Ultra, welcher noch im kommenden Jahr auf 16 Stapel ("Stacks") mit HBM4e-Speicher setzen wird, sowie der Next-Next-Gen Feynman (2027/28) auch bereits die Nachfolger in den Startlöchern.

Weitere Informationen liefert die rund 105-minütige Keynote von der Nvidia GTX 2025 in Washington, D.C., welche auf YouTube zum Abruf verfügbar ist.

Im Rahmen der Nvidia GTC ("GPU Technology Conference") 2025 in Washington, D.C., welche das Unternehmen aus Santa Clara mittlerweile als KI-Konferenz bezeichnet, hat Nvidia-CEO und Gründer Jensen Huang den neuen Vera Rubin Superchip und darauf basierende Compute- und KI-Lösungen erstmals öffentlich gezeigt. In technologischer Hinsicht beeindruckt Nvidias Next-Gen wieder enorm.

Der Nvidia Vera Rubin Superchip, welcher sich aus insgesamt zwei Rubin-GPUs mit 288 GiByte HBM4-Speicher und einer Vera-CPU mit 88 Custom-ARM-Prozessorkernen sowie 176 Threads zusammensetzt und von 2 Terabyte LPDDR5X-Systemspeicher flankiert wird, verbindet seine Komponenten über ein NVLink-C2C-Interconnect, welches eine Bandbreite von bis zu 1,8 Terabyte pro Sekunde bereitstellt.

Während der Vera Rubin Superchip eine FP4-Leistung von 50 PetaFLOPS bereitstellt, gehen die Lösungen auf Basis von Nvidias "Next-Gen-Superchip" noch einmal deutlich weiter. Das "Vera Rubin Compute Tray" mit vier Superchips erreicht 200 PetaFLOPS, während das "Vera Rubin CPX Compute Tray" mit acht zusätzlichen Rubin-GPUs insgesamt bis zu 440 PetaFLOPS Inference-Leistung bereitstellen kann.

Doch damit noch nicht genug: In der zweiten Jahreshälfte 2026 möchte Nvidia mit der Vera Rubin NVL144-Plattform eine Lösung anbieten, welche bis zu 3,6 ExaFLOPS ("FP4") für Inference und 1,2 ExaFLOPS ("PF8") für KI-Training bereitstellt.

Wie Nvidia-CEO Jensen Huang demonstrierte, stehen mit Rubin Ultra, welcher noch im kommenden Jahr auf 16 Stapel ("Stacks") mit HBM4e-Speicher setzen wird, sowie der Next-Next-Gen Feynman (2027/28) auch bereits die Nachfolger in den Startlöchern.

Weitere Informationen liefert die rund 105-minütige Keynote von der Nvidia GTX 2025 in Washington, D.C., welche auf YouTube zum Abruf verfügbar ist.

Kommentare